בינה מלאכותית ולמידת מכונה תמיד נהנו מיחסי ציבור מצויינים, אבל אחרי שנכנסו לחיינו מחוללי תמונות וטקסט - ביניהם DALL-E, Midjourney ו-ChatGPT - נראה שיש כמעט קונצנזוס על כך שהבינה המלאכותית תשתלט על חיינו. בפוסט זה ננסה להסביר מה עומד מאחורי מכונות אלו, ואולי חשוב יותר - מה לא.

המונח "בינה מלאכותית" (AI - Artificial Intelligence) מתקשר אצל רבים מאיתנו לסצנות מדע בדיוני שבהן רובוט דמוי אדם מפגין תבונה אנושית (אם נולדתם בשנות ה-90-80 אז במבטא אוסטרי ועל רקע פיצוצים). מקרה כזה הוא דוגמה לבינה מלאכותית כללית (או "חזקה") - מכונה המסוגלת לכל פעולה מחשבתית שאדם מסוגל לבצע (אם כי השאלה "מהי בינה?" היא שאלה פילוסופית פתוחה, שלא ניכנס אליה פה). מסיבות ברורות, אנשי תקשורת וחברות שמתעסקות בטכנולוגיה זו משמרים סביבה הילת מסתורין, אבל מומחים בתחום אומרים כבר מזמן: "תפסיקו לקרוא לכל דבר בינה מלאכותית, אנשים מדברים כאילו למחשבים יש חשיבה תבונית - וזה לא כך" [1]. המכונות הקיימות היום, מרשימות ומתוחכמות ככל שיהיו, מסוגלות לבצע פעולות ספציפיות מאוד, והושקעו שנות אדם רבות בתכנון ובאימון כדי להתאים את המכונה לפעולות אלה בלבד. עד כמה טובה המכונה בביצוע הפעולות האלה, ומה המגבלות שלה? ננסה להתעמק בזה בפוסט.

בפרקים הקודמים של "בינה מלאכותית": למידת מכונה (Machine Learning) היא שם כללי לאלגוריתמים ולאנליזה מתמטית המאפשרת למחשב להכליל - כלומר לבצע החלטה בנוגע למקרה שלא ראה קודם ולא תוכנת לו במפורש. התהליך דומה רעיונית לאדם הלומד בעזרת דוגמאות מהשיעור ומיישם את מה שלמד על שאלה בבחינה שלא ראה קודם. כתלות ביישום, אלגוריתמים אלו יכולים להסתמך על מתמטיקה ממגוון תחומים - סטטיסטיקה, עיבוד אותות ועוד. בשנים האחרונות, עם ריבוי המידע והתחזקות יכולות החישוב, גוברת הפופולריות של אלגוריתמים חישוביים המבוססים רשתות עצביות מלאכותיות (Artificial Neural Network).

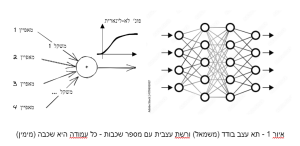

אמנם המונח "עצב" שואב השראה (ואת שמו) מהנוירונים שבמוח, למעשה מדובר בחישוב מתמטי די פשוט, והוא אבן הבניין היסודית שממנה בנויות כל המכונות המתוחכמות שכמעט האמנו שיחריבו את האנושות בקרוב. העצב מקבל מספר מאפיינים מספריים (הנקראים features), מכפיל כל אחד מהם במשקל (כלומר מתעדף את רמת ההשפעה שלהם) ומפעיל על הסכום המשוקלל פונקציה לא-לינארית (למה זה חשוב? קראו פה [2]). "עצבים" רבים המחוברים זה לזה בשכבות נקראים רשת (ראו איור 1). ככל שמגדילים את "עומק" הרשת (כלומר הרשת מורכבת משכבות רבות יותר), נוצרים קשרים מורכבים יותר - שיטה זו נקראת למידה עמוקה [3].

איור 1 - תא עצב בודד (משמאל) ורשת עצבית עם מספר שכבות - כל עמודה היא שכבה (מימין)

בתהליך האימון, או ה"למידה", הרשת מקבלת דוגמאות רבות ומעדכנת את אותם משקלים ב"עצב" כדי למזער את השגיאה שבין תוצאת החישוב של הרשת לתוצאת האמת של הדוגמאות (גם על זה תוכלו לקרוא כאן [3]). תהליך זה מגדיר את אחת המגבלות המשמעותיות של האלגוריתם: הוא טוב רק כטיב האימון שלו והדוגמאות שהוא ראה. נאמר שאימנו את הרשת להבדיל בין תמונות של כלבים לתמונות של חתולים, וכעת נתנו לה כקלט תמונה של צב נינג'ה - הפלט ככל הנראה יהיה תיוג כחתול או ככלב. חשוב לציין שהמבנה שתיארנו עד כה הוא רשת בסיסית למדי שנמצאת בשימוש רחב, אך קיימים מבנים נוספים (המכונים "ארכיטקטורה") בהתאם לשימושים השונים.

נתמקד לדוגמה במכונה שמקבלת הרבה תשומת לב לאחרונה: ChatGPT של חברת OpenAI. זהו מעין "בוט" המאפשר "לשוחח" איתו בטקסט חופשי ונותן תשובות שנראות בדרך כלל אנושיות מאוד. המבנה של מכונה זו די שונה מהרשת הבסיסית שתיארנו - זוהי רשת מסוג מודל שפה גדול (Large Language Model) ומשתמשים בה בשיטה שנקראת self-attention כדי לנתח משפטים שלמים ואת היחסים בין המילים שבהם, על-ידי "קידוד" טקסט חופשי לאוסף משקלים המייצגים תכונות (הסבר מפורט ב-[4]). הרשת אומנה על המוני טקסטים מהאינטרנט (אגב, בעיקר על מידע עדכני עד ל-2021) כדי לצפות את המענה לטקסט המקודד, ומתרגמת אותו באותה שיטה לטקסט חופשי שנראה ממקור אנושי. זו נקודה קריטית: בבסיסו ה-ChatGPT מתוכנן לנבא את המילה הבאה בטקסט. הוא לא תוכנן להעריך את נכונות הפלט שלו ולא מנסה לעשות זאת, ולכן כשמשתמשים בו כדי לתת תשובות לשאלות כלליות, בדרך כלל מתקבל טקסט מרשים מבחינת ה"אנושיות" שלו, אבל התשובות בקלות יכולות להיות בלתי אינפורמטיביות או פשוט שגויות (תופעה שנקראת Hallucination או חזיון שווא). לדוגמה, אם תתבקש המכונה לצטט מאמרים בתחום מסוים, היא עלולה לספק כותרות ענייניות, ואפילו שמות של כותבים מוכרים, אבל המאמרים פשוט לא קיימים. גם אתם יכולים לאתגר אותה בקלות בנושאים מעט מורכבים שאתם מומחים בהם, ולזהות אי דיוקים או שטויות מוחלטות.

הנה בעיה חמורה אף יותר - היות שהמכונות לומדות מהמידע שזמין באינטרנט, הן חשופות מאוד להטיות האנושיות שלנו. כתבה של "כאן" [5] מראה כיצד כשמבקשים ממכונה לייצר תמונה של רופא מקבלים גבר, אבל כשמבקשים לייצר מנקה מתקבלת אישה (באנגלית doctor ו-housekeeper שניהם נטולי מגדר).

תחכומים נוספים מייחדים את ChatGPT מגרסאות קודמות ומאלגוריתמים דומים והקנו לו את תהילתו המוצדקת. נציין בעיקר, שהאימון על בסיס טקסטים באינטרנט עובר שיפור נוסף על ידי משוב אנושי [7] (באמצעות שיטה אחרת מתחום למידת המכונה בשם Reinforcement Learning - אבל זה נושא לפוסט נפרד). בינתיים נסתפק במסקנה שמוקדם להיבהל ולשקול עבודה חדשה. שימוש מושכל במכונות כמו ChatGPT יכול להועיל, אבל חשוב לזכור את מגבלות המכונה, ולא לשאול אותה שאלות הרות גורל.

עריכה: שיר רוזנבלום-מן

מקורות לקריאה נוספת:

[1] מומחה בתחום למידת המכונה מתנגד לשימוש במונח "בינה מלאכותית".

[2] על פונקציות אקטיבציה לא-לינאריות.

[3] פוסט על רשתות עצביות מלאכותיות ולמידה עמוקה

[4] כיצד Large Language Model מבין הקשרים במשפטים

[5] דוגמאות להטיות במחוללי תמונות

[6] עוד על הייחוד של ChatGPT ולמידה מתוך פידבקים אנושיים